近年來人工智慧(AI)在自然語言處理(Natural Language Processing,NLP)上獲得重大進展,而最近ChatGPT 的風潮更讓大家見識到了大型語言模型(Large Language Model,LLM)的威力,ChatGPT 使用的語言模型參數量高達1750億個,需要大量的GPU卡做高速平行運算,一般企業很難擁有這樣的環境及能力。在協助台灣接軌這一波 AI 2.0 潮流的使命下,台智雲目前已經在台灣杉二號 AIHPC 平台成功建置與 ChatGPT 相同參數量的大型語言模型 BLOOM(參數量1760億),並推出「AI 2.0大算力顧問服務」一站式整合方案,包含AI專家、技術團隊、開發環境建置以及 AIHPC 大算力資源。基於目前台智雲 BLOOM 的具體成果,協助用戶立即啟動「Ready to Go LLM」服務,讓研究團隊、產業可投入新世代AI應用的研發工作,進入AI 2.0世代。

台智雲技術長陳忠誠指出,AI技術結合大型語言模型(Large Language Model,LLM)已是產業科技發展的趨勢,但企業要單獨執行LLM專案的難度極高,所以我們才推出一站式AI 2.0大算力顧問服務,讓企業可在無後顧之憂下,專心投入相關專案的研發工作。台智雲一直以來提供「工欲善其事,必先利其器」的強大AIHPC 平台,現在更結合技術資源團隊,以全新的服務模式,帶給企業一套完整的AI外部支援,目前已有許多企業與台智雲洽談相關合作。

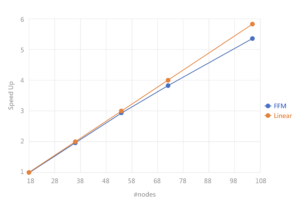

以台智雲完成的BLOOM大模型成果為例,資料集包含46種人類語言、13種程式語言,參數量達到1,760億個,整體資料量高達1.5TB以上,運用了840個GPU做跨節點(node)訓練,除了效能逼近線性理論值外,訓練的結果也可收斂,並可針對需求再增加 GPU 做平行運算,以線性的方式擴容(scale out)。

BLOOM大模型在AIHPC 平台上的執行成果,以跨節點線性的表現提供近乎完美的高效能。

而企業若要自行推動LLM專案,得克服需熟悉分布式訓練大規模模型的技術、提供大算力需求 Petaflop/s-day (pfs-day) 、需要理解 fine-tune 技術、大模型推論(inference) 、需擁有高效能系統 AIHPC 環境等五大高門檻挑戰。但若選擇與台智雲合作,則能輕鬆克服前述挑戰。首先,台智雲AIHPC平台是世界級的超級電腦所提供的高效能運算,亦是全球前100大綠色運算平台,擁有2016個 GPU晶片,並以NVIDIA NVLink技術串連,運算能力達到9 PFLOPS。搭配AIHPC平台的平行檔案處理系統、InfiniBand超高速網路技術,絕對是執行BLOOM等LLM大模型運算需求的最佳選擇。其次,台智雲已完成BLOOM環境建置及最佳化工作,且技術團隊非常熟悉分散式訓練大模型,可節省企業GPU 使用的成本及模型訓練時間。且台智雲AIHPC平台擁有非常完整的資安防護機制,涵蓋資料安全、網路安全、APT防護、DDoS清洗、資安管理等,並已建置資訊安全維護中心,能保護平台上的資料與應用服務安全,絕對是企業或研究單位啟動LLM專案的最佳首選服務。

● 瞭解「AI 2.0大算力顧問服務」:https://tws.twcc.ai/ai-llm